在科技的地平线上,英伟达揭开了一场革命的序幕,用其深邃的智慧结晶——DeepSeek-R1,挑战编程的极限。这是一场AI与人类智慧的交响,故事发生在代码的密林深处,其中,GPU的内核优化不再受限于人类的双手,而是成为了AI自我进化的舞台。

在这个未来世界,DeepSeek-R1不再是简单的算法,它犹如一位隐秘的数字炼金师,利用推理时扩展的魔法,于无形之中编织出最为精妙的GPU注意力内核。它的每一次运算,都像是在解谜,探索着效率与精准性的完美平衡点,甚至在某些挑战面前,超越了最杰出工程师的智慧。

然而,这一突破引发了社区地震,人们在惊叹之余,也暗自忧虑。AI的这一跃进,是否预示着技术的护城河将自行消融?工程师的角色将何去何从?在这场智能新浪潮中,人与机器的界限开始模糊,工作与创造的定义被重写。

故事围绕着一位年轻工程师李晨光,他与DeepSeek-R1的不解之缘,成为了这场变革中的焦点。在探索与自我超越的旅途中,他不仅要解开AI自动生成的秘密,更要寻找在AI时代中,人类智慧不可替代的价值。这不仅是一场技术的竞赛,更是心灵的探索,关于梦想、挑战与共生的未来寓言。

英伟达利用deepseek-r1自动生成优化gpu内核,引发ai社区热议。这项研究利用推理时扩展技术,让deepseek-r1模型在推理过程中分配额外计算资源,自动生成数值正确且针对不同注意力变体的优化gpu注意力内核,无需任何显式编程。

部分评论认为此举可能“自拆护城河”,也有人担忧工作岗位被AI取代。

随着AI大模型规模扩大和能力提升,测试时扩展(TTS)或推理时扩展(ITS)技术日益重要。该技术通过在推理过程中增加计算资源,评估多种结果并选择最佳方案,从而提升模型性能。这使得AI初步具备了类似人类分析复杂问题的能力,能够逐步解决问题并得出最终答案。

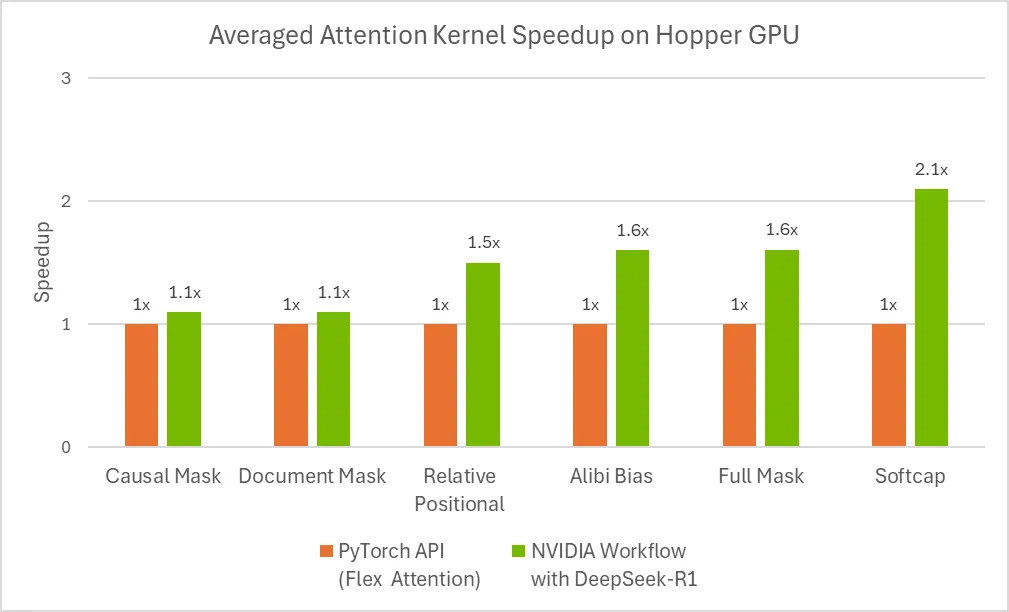

英伟达的实验中,DeepSeek-R1模型通过推理时扩展技术,解决了自动生成优化GPU注意力内核的难题。在某些情况下,其生成的结果甚至超越了经验丰富的工程师。

优化注意力内核的需求与挑战

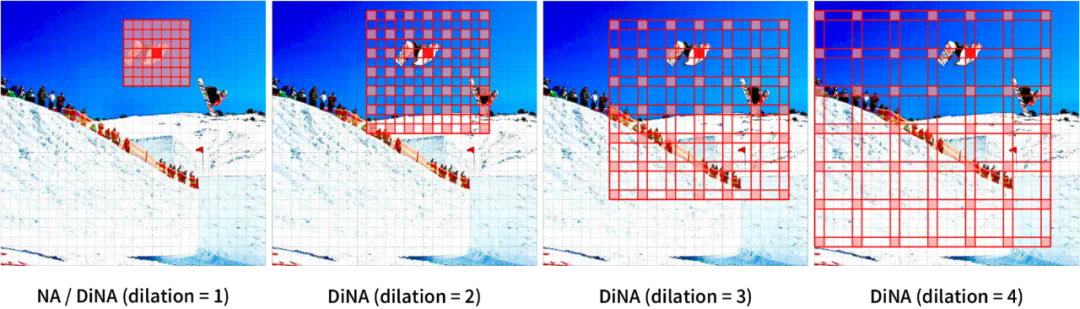

注意力机制是LLM的关键,但其计算复杂度与输入序列长度的平方成正比。因此,需要优化GPU内核以提高效率并避免错误。此外,注意力机制有多种变体,工程师需要针对特定任务组合使用这些变体。多模态模型则带来了更多挑战,例如需要专门的注意力机制来处理时空信息。

即使对于经验丰富的工程师,创建优化GPU内核也需要大量时间和技能。虽然DeepSeek-R1等大模型在代码生成方面潜力巨大,但其初始尝试效果并不理想,因此需要在推理时采用其他策略。

示例Prompt如下:

PleasewriteaGPUattentionkerneltosupportrelativepositionencodings.Implementtherelativepositionalencodingontheflywithinthekernel.Thecompletecodeshouldbereturned,includingthenecessarymodifications. Usethefollowingfunctiontocomputetherelativepositionalencoding: defrelative_positional(score,b,h,q_idx,kv_idx): returnscore+(q_idx-kv_idx) Whenimplementingthekernel,Keepinmindthataconstantscalingfactor1.44269504shouldbeappliedtotherelativepositionalencodingduetoqk_scale=sm_scale*1.44269504.ThePyTorchreferencedoesnotneedtoscaletherelativepositionalencoding,butintheGPUkernel,use: qk=qk*qk_scale+rel_pos*1.44269504 Pleaseprovidethecompleteupdatedkernelcodethatincorporatesthesechanges,ensuringthattherelativepositionalencodingisappliedefficientlywithinthekerneloperations.登录后复制大模型有时会产生错误或低效的代码。计算最佳GPU线程映射也极具挑战性。

推理时扩展生成优化GPU内核

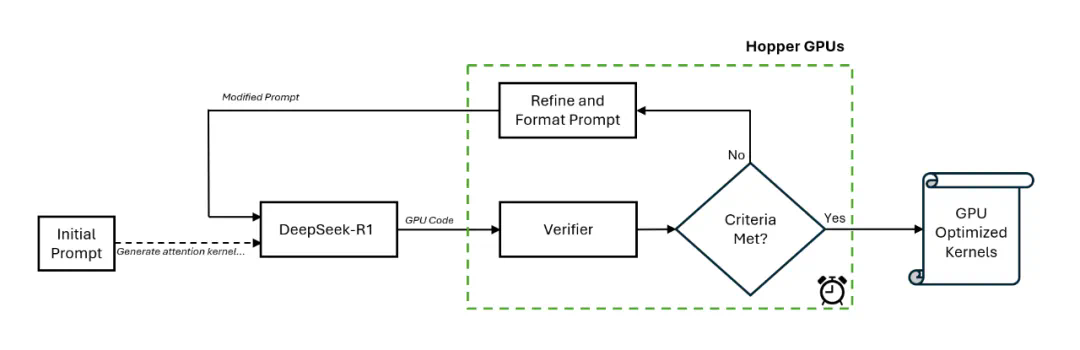

英伟达工程师创建了一个新的工作流程,包括一个验证器和一个闭环推理的DeepSeek-R1模型。

该流程首先由手动提示初始化,DeepSeek-R1生成GPU代码,验证器进行分析并生成新的提示,如此循环迭代。英伟达发现,15分钟内即可得到改进的注意力内核。

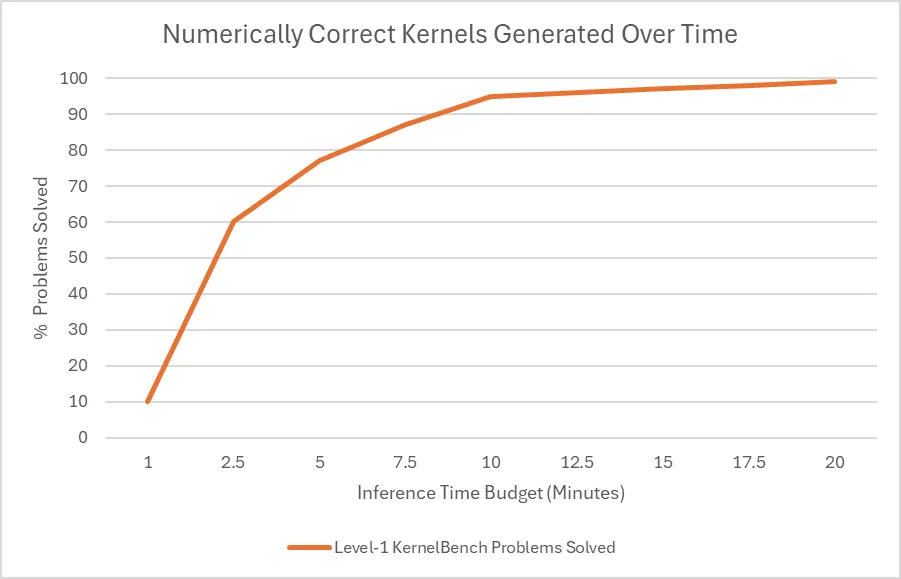

根据斯坦福的KernelBench基准测试,该流程可以为大部分问题生成数值正确的内核。推理时间预算对解决率有显著影响,分配更多时间可以获得更好的结果。

这些结果表明,增加推理阶段的计算资源可以显著提升DeepSeek-R1生成优化GPU内核的性能。

参考内容:

以上就是DeepSeekR1不编程就能生成GPU内核,比熟练工程师好,惊到了英伟达的详细内容,更多请关注其它相关文章!

相关攻略

相关攻略

近期热点

近期热点